A era da inteligência artificial generativa, iniciada após o lançamento do ChatGPT em novembro de 2022, abriu um novo leque de possibilidades e, com isso, surgiram novas funções para atender às demandas. Entre elas, destacou-se a Engenharia de IA.

Inicialmente conhecida como Engenharia de Prompt ou Engenharia de LLM, essa função foi vista por muitos como uma simples habilidade de “conversar” com a máquina, limitada a chamadas à API da OpenAI com instruções via prompt, utilizando frameworks como LangChain e LlamaIndex. Porém, essa percepção mudou rapidamente, a profissão provou seu valor e tornou-se uma das mais desejadas pelo mercado, com remuneração elevada, entregando soluções para otimização de processos, automação de tarefas e melhoria da experiência do cliente.

Fontes:

Início: O Hype do Prompt

Inicialmente, a promessa da IA generativa parecia simples: bastava conectar um Large Language Model (LLM) com uma engenharia de prompt bem elaborada (utilizando técnicas como one-shot, few-shot e o uso de tags XML) e RAG básico (busca por similaridade em uma base de dados), e todos os problemas estariam resolvidos. Chatbots inconsistentes, alucinações e experiências frustrantes se tornaram comuns, gerando desconfiança. Essas falhas, no entanto, impulsionaram o desenvolvimento de novas técnicas.

Arquiteturas RAG e Integração

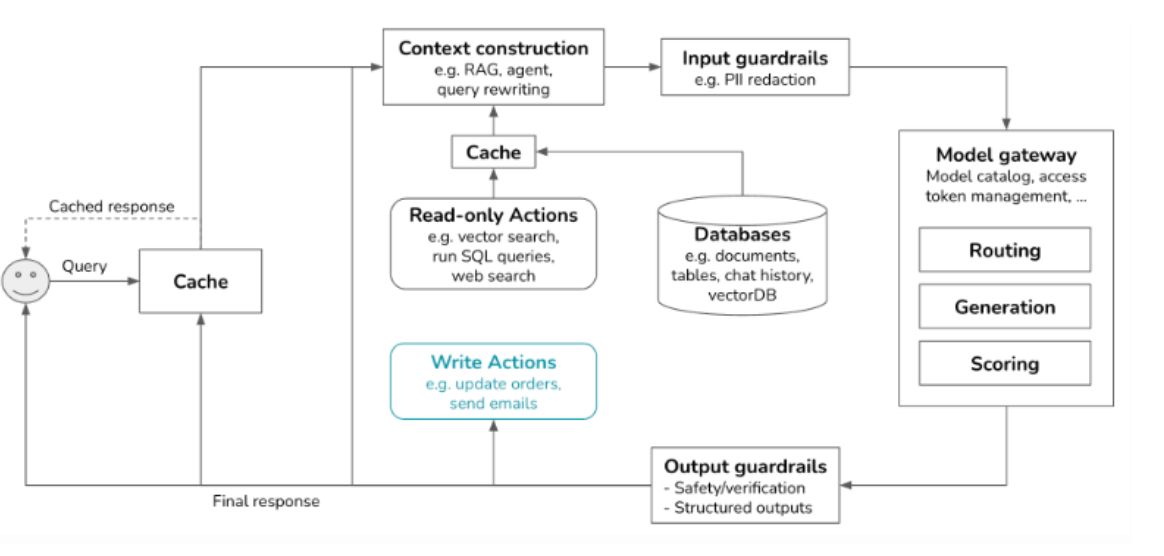

Com a experiência adquirida, o mercado começou a identificar padrões eficazes, criar técnicas e adaptar conceitos antigos. As soluções evoluíram, e os resultados melhoraram. Compare, por exemplo, as arquiteturas propostas por Chip Huyen em abril de 2023:

Fonte:

Building LLM applications for production

Com a de Julho de 2024:

Fonte:

Building A Generative AI Platform

O RAG, por exemplo, evoluiu para diversas variações como Adaptive RAG, Graph RAG, Advanced RAG e Agentic RAG, cada uma utilizando técnicas diferentes.

Além disso, a necessidade de um conhecimento maior de engenharia de software (para projetar sistemas complexos e escaláveis) e engenharia de dados (para garantir a qualidade, pré-processamento e vetorização de dados em bancos vetoriais) tornou-se indispensável.

Agentes e Protocolos

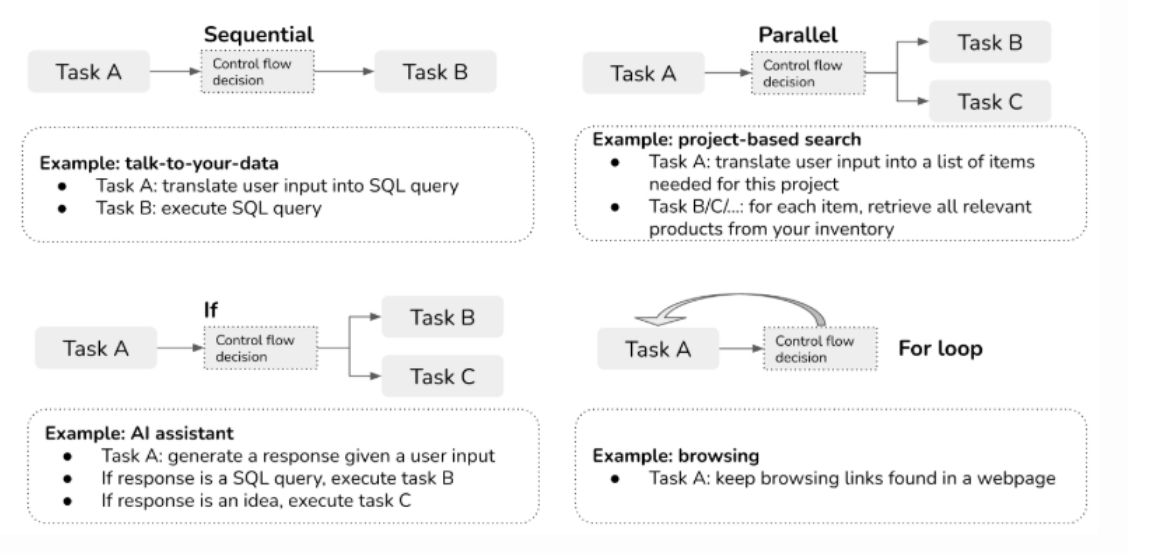

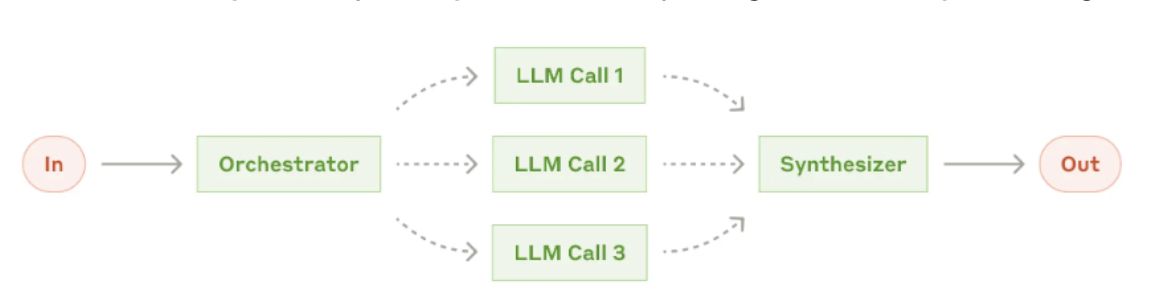

Hoje, as aplicações possuem workflows estruturados e objetivos claros, integrando não apenas um, mas vários agentes em uma única aplicação. Em muitos casos, os LLMs foram substituídos por SLMs (Small Language Models), mais eficientes para tarefas específicas e muito mais econômicos. Além disso, protocolos como MCP (Model Context Protocol), focado em padronizar a troca de contexto entre componentes, e A2A (Agent-to-Agent), que estabelece regras para a comunicação e orquestração entre múltiplos agentes, começam a surgir.

Fontes:

Construindo Agentes de IA Eficazes – Anthropic

Engenharia de Contexto.

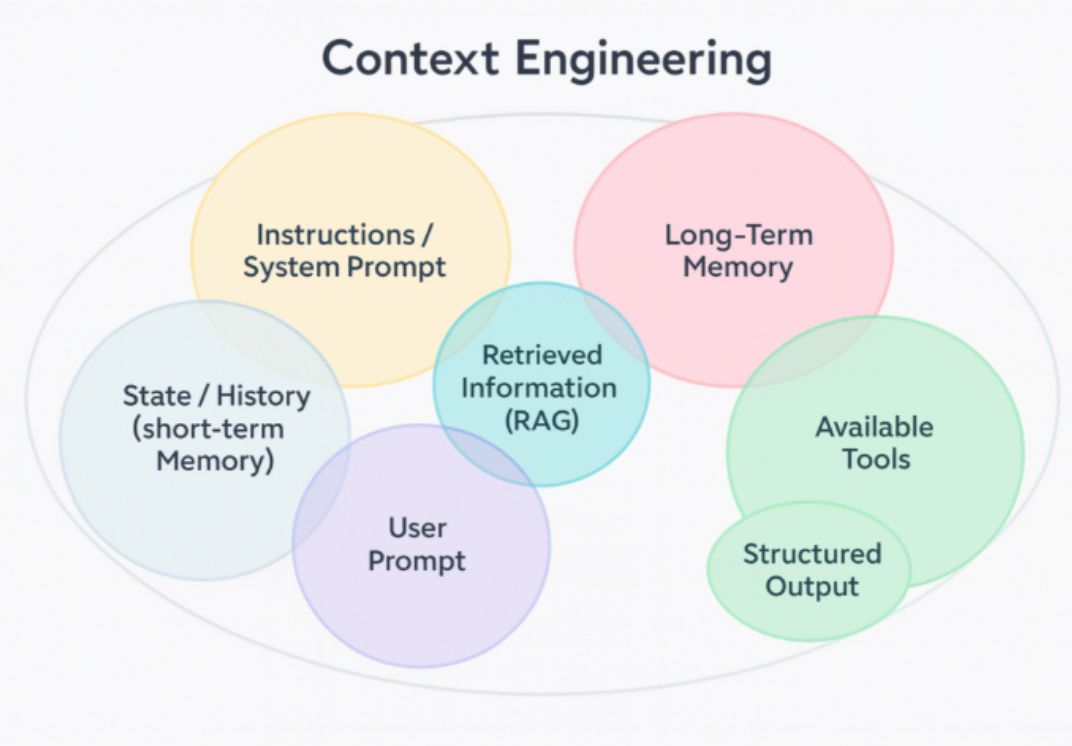

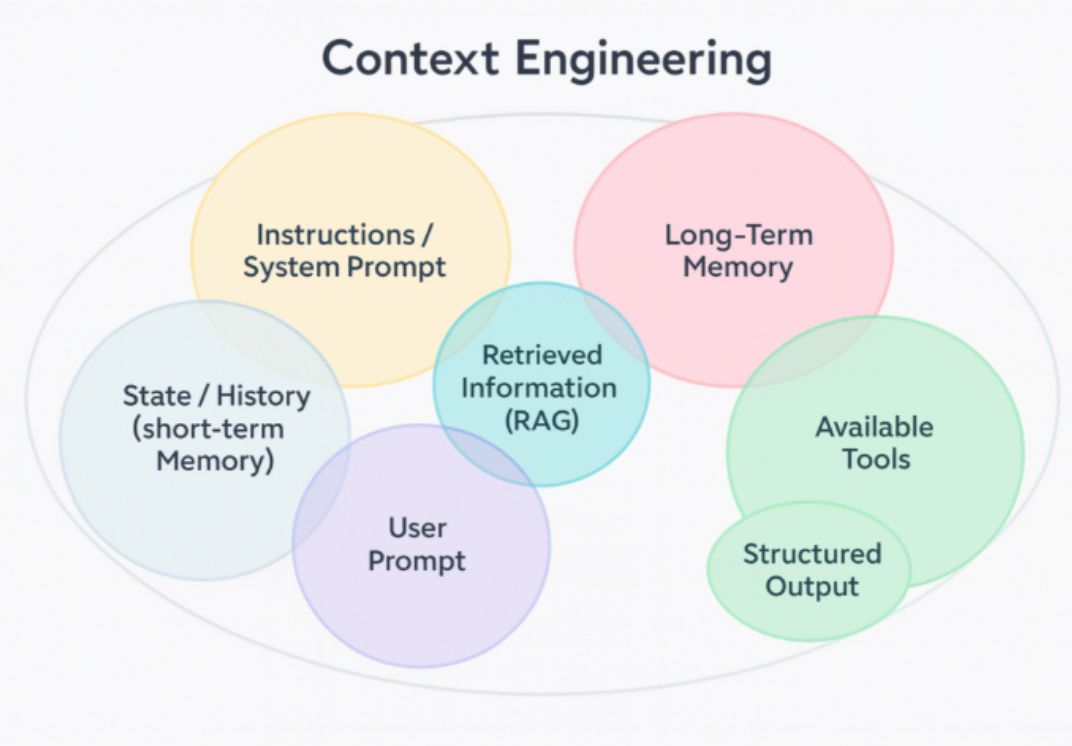

Em junho de 2025, surgiu o termo Engenharia de Contexto, consolidando práticas que já existiam, mas eram tratadas de forma isolada. Ela é o pilar arquitetônico para o desenvolvimento de Agentes, permitindo integração e gestão inteligente de múltiplos componentes:

- Uso de ferramentas externas.

- Memórias de curto e longo prazo.

- Contexto compartilhado entre agentes.

- Saídas estruturadas e coerentes.

- Engenharia de prompt.

- RAG.

Fontes:

Engenharia de Contexto para Agentes de IA: Lições da Construção do Manus

Próximos desafios: Plataforma de IA

O mercado vem mostrando sinais claros de que as responsabilidades de um Engenheiro de IA não serão mais apenas construir soluções isoladas, e sim ecossistemas inteiros que escalam. Com a consolidação da Engenharia de Contexto será necessário pensar cada vez mais em Plataformas de IA Generativa (GenAI Platforms). O desafio passa a ser a eficiência e a governança em escala.

O case da GenPlat do iFood é um exemplo claro dessa transição. Os desafios agora incluem:

- Uniformização e Abstração de Modelos: Em vez de integrar um único LLM ou SLM, o engenheiro de plataforma precisa abstrair a complexidade de múltiplas famílias de modelos (OpenAI, Gemini, Llama, modelos on-premise) em uma única interface com fallbacks automáticos para o sistema não cair. O desafio é garantir que diferentes equipes de produto possam usar o melhor modelo para sua necessidade, sem se preocupar com a complexidade da chamada à API, tokens ou custos.

- Gestão de Custos e Latência em Escala: Serviços que gerenciem dinamicamente o caching, o rate-limiting e a otimização de prompts para reduzir custos, mantendo a latência baixa.

- Governança e Segurança Centralizada: Quando centenas de aplicações consomem a IA, a necessidade de segurança, privacidade de dados e compliance se torna central.

- Desenvolvimento de Componentes Reutilizáveis: O foco muda de construir uma solução RAG para construir Serviços RAG reutilizáveis que qualquer equipe interna possa conectar. Isso inclui desenvolver serviços de memória, serviços de orquestração de agentes e serviços de rastreamento (tracing) padronizados, acelerando o desenvolvimento de todas as soluções.

Quer dominar os principais conceitos da Engenharia de IA?

Conheça o nosso Ebook, e ao adquirir o nosso material, já garante a sua vaga no Workshop aonde iremos demonstrar um case de IA, utilizando os principais conceitos da Engenharia de IA.

Data: 21/10/2025.

Horário: 19:00.

Muito Obrigado.

Até o próximo artigo

Moisés Arruda

Engenheiro de IA