Carga incremental de dados com DBT

Neste artigo, vamos falar sobre a ferramenta dbt (Data Build Tool), focando especificamente na realização de cargas incrementais em nossos modelos. Ao criarmos um modelo e realizarmos a primeira carga de dados, pode não ser vantajoso executar uma carga completa (full load) a cada atualização, especialmente em projetos com grande volume de dados. É justamente

Leia mais

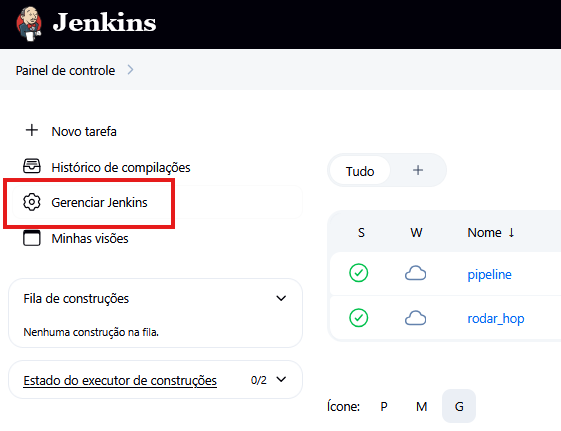

Envio de e-mail no Jenkins

No artigo passado, mostramos as vantagens de utilizar o Jenkins para automação de jobs. E embora ele mostre o histórico das execuções — incluindo quantas falharam e quantas foram bem-sucedidas — ainda é um trabalho chato ter que abrir o console todos os dias para verificar os jobs um por um. É aí que entra

Leia maisComo acessar os dados do seu Lakehouse?

Bom, na semana passada tivemos mais uma Live dos Sparkanos, e dessa vez com um Hand-ons de 2 horas de Apache Spark. E uma das dúvidas que surgiram, foi entender como o cliente acessa esses dados, uma vez que processamos os dados com o Spark. Para facilitar o entendimento vou deixar um tutorial abaixo desde

Leia maisRecuperando dados da Receita Federal com Apache Hop

Recentemente, explorei o uso do Apache Hop, uma poderosa ferramenta de ETL (Extração, Transformação e Carga) que facilita a automação e gestão de processos complexos de integração de dados. Neste post, quero compartilhar um pouco sobre como o Apache Hop pode transformar seu processo de integração de dados, especialmente quando se trata de automatizar tarefas

Leia mais

Case – Data Lake 100% Open Source com Apache Spark

Olá, Hoje vamos ter uma Super-Live! Iremos demonstrar um case que implementamos de um Data Lake 100% Open Source em uma grande empresa aqui em Portugal. Para toda a etapa de Processamento e tratamento dos dados utilizamos o Apache Spark para processar, criando uma Solução robusta e escalável. Quer saber mais detalhes? Assista a nossa

Leia mais

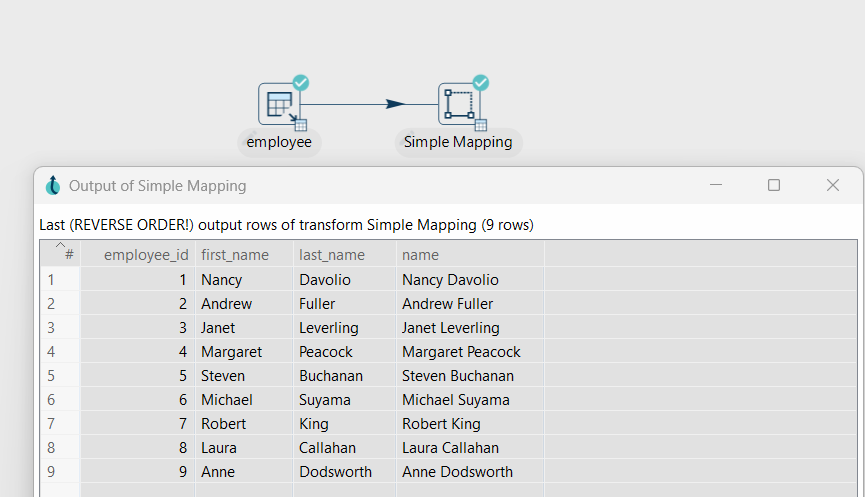

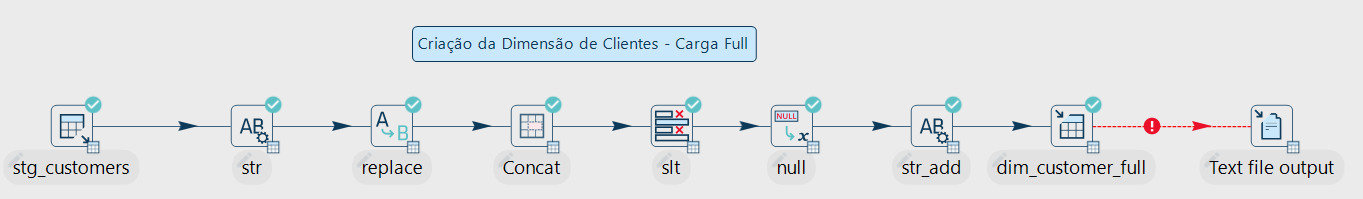

Aumenta a produtividade do teu ETL com Apache Hop

Imagina que o sistema da tua empresa guarda os dados de pessoa em duas colunas, nome e sobre-nome. E ao criar um DW, provavelmente que iremos ter esse tratamento de dados em alguns etl, como nas seguintes dimensões: Dim_Funcionarios. Dim_Clientes. Dim_Leads. Em todas dimensões mencionadas acima teriamos que fazer um mesmo tratamento, que é concatenar

Leia maisCriando uma Infra na Google Cloud com Terraform

Olá, tudo bem contigo? Já imaginou subir o teu ambiente de Desenvolvimento em 1 min na Cloud? Pois bem eu achava que isso era algo muito distante, algo que somente programadores ou profissionais de Devops poderiam fazer, acho que me enganei mais uma vez. Nos últimos 2 anos temos tido quase que uma imersão em

Leia mais

Utilizando o Error Handling para minimizar os problemas do seu ETL.

Olá, Tudo bem contigo? Hoje venho trazer uma dica que se soubesse desde o início teria ganho boas horas de sono, pois bem. Quantas vezes você já teve problemas de carga no seu ETL, imagina que está carregando um milhão de registros na sua tabela e por causa de um erro em um registro toda

Leia maisA Importância do Comando EXPLAIN ANALYSE em Sistemas de Gerenciamento de Bancos de Dados

A Importância do Comando EXPLAIN ANALYSE em Sistemas de Gerenciamento de Bancos de Dados Introdução Dentro do universo dos sistemas de gerenciamento de bancos de dados (SGBDs), como PostgreSQL, a ferramenta EXPLAIN ANALYSE desempenha um papel crucial na otimização e eficiência das consultas SQL. Este artigo detalha o uso do EXPLAIN ANALYSE, fornecendo exemplos práticos e

Leia mais

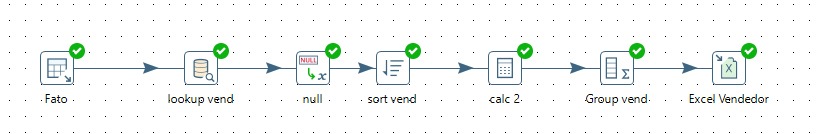

Case – Automatizando processos de um Cliente

Olá, tudo bem contigo? Hoje estamos aqui para compartilhar um projeto que estamos desenvolvendo para um dos nossos clientes, e um tema muito importante, automatização de processos. Atualmente é muito comum pensarmos em projetos de BI, Big Data mas o teu cliente já tem os processos automatizados? Pois não adianta querer Criar uma solução de

Leia mais