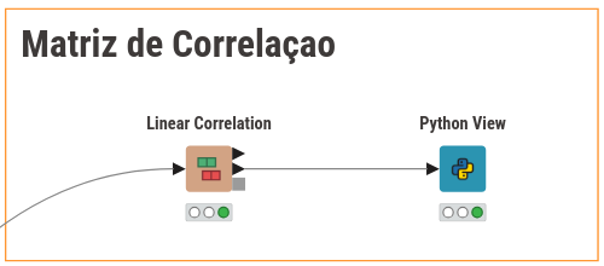

Python ou KNIME: Qual a Melhor Escolha? Por Que Não Ambas?

Introdução A análise de dados moderna exige ferramentas que equilibrem automação, flexibilidade e poder computacional. Um cientista de dados que precisa processar grandes volumes de informações pode optar por uma abordagem visual e automatizada no KNIME, simplificando a construção de workflows sem a necessidade de codificação manual. Por outro lado, se for necessário desenvolver um

Leia mais

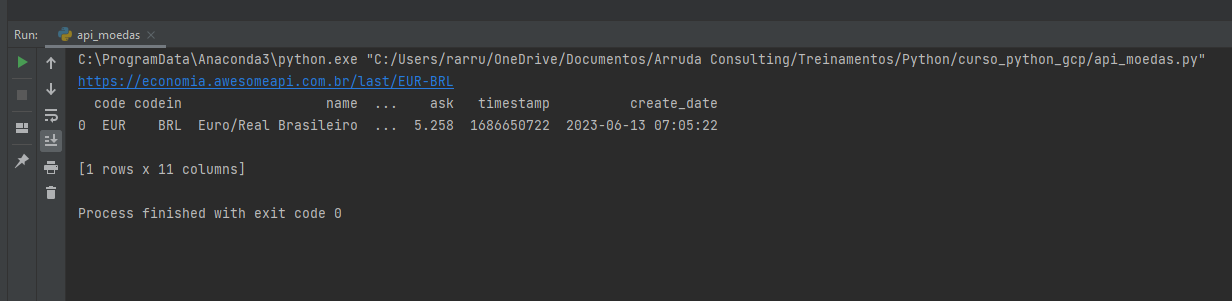

Trabalhando com API no Python

Olá, tudo bem contigo? Quando falamos em API, as pessoas pensam muito em ferramentas, porém se esquecem que o mais importante é entender a API, saber qual é o método, se tem algum token, qual o seu Header, e por ai vai. E a minha dica é sempre começar pelo Postman ou Insominia para tentar

Leia mais

Treinamento: Python para Engenheiro de dados – 1º dia

Olá, Tudo bem contigo? Nesse sábado, 20/05/2023, tivemos o 1º dia do nosso mais novo treinamento, Python para Engenheiro de dados, aplicado pelo instrutor Leandro Silva. Neste sábado foram abordados os seguintes temas: Criação da conta na Google Cloud. Utilizamos o IAM para criar as permissões e acessos. Criação de um banco de dados na

Leia maisPandaSQL: Como usar SQL em Dataframes do Pandas

Pandas é uma das bibliotecas mais populares do Python para análise de dados. Ele oferece muitas funções para manipular, visualizar e extrair informações de seus dados. Porém, há momentos em que os usuários precisam de recursos adicionais para manipular dados com maior precisão e rapidez. É aí que entra o pandasql, uma ferramenta que permite

Leia maisComo utilizar a função Zip() no Python

O Python é uma linguagem de programação muito versátil e poderosa, com muitas ferramentas úteis para ajudar a simplificar o desenvolvimento de software. Uma dessas ferramentas é a função zip() que permite combinar elementos de duas ou mais listas em uma única lista. A função zip() é usada para juntar duas ou mais listas em

Leia maisPipeline de Dados Usando Python

Introdução Um dos principais desafios da engenharia de dados é lidar com grandes volumes de dados e garantir que eles sejam processados de forma eficiente e escalável. Para isso, é essencial criar um pipeline de dados que permita ler, transformar e carregar dados de forma automatizada e eficiente. Neste artigo, vamos explorar como criar um

Leia mais